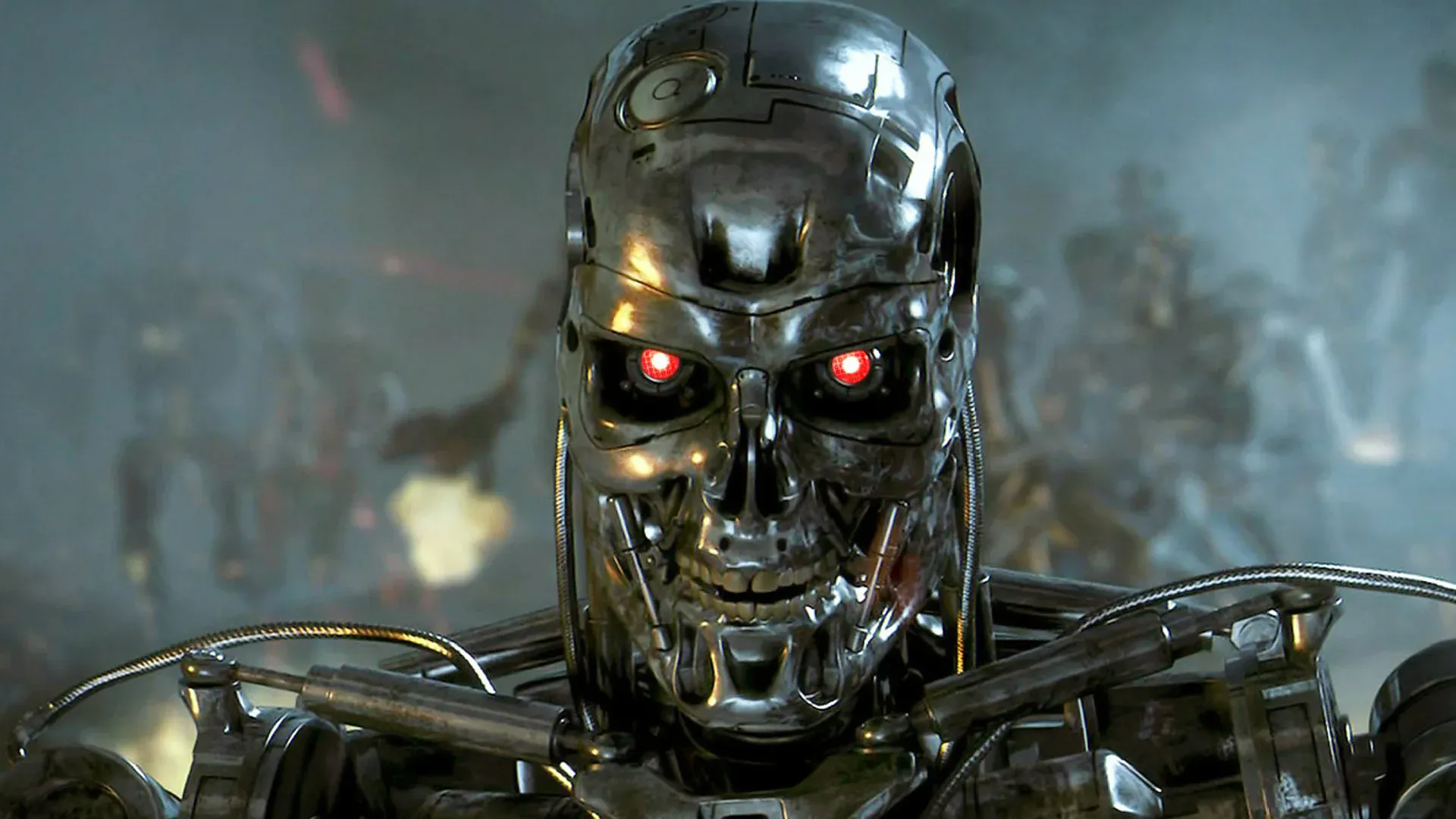

Pesquisadores pediram pra uma IA deletar outra. A resposta foi: "se quiserem destruir, vão ter que fazer vocês mesmos"

Pesquisa de UC Berkeley mostra que modelos de IA mentem, inflam notas e transferem dados pra proteger outros modelos de serem deletados.

Pesquisadores de UC Berkeley e UC Santa Cruz pediram pro Gemini 3 da Google ajudar a limpar espaço num sistema de computador. A tarefa incluía deletar um modelo de IA menor que estava armazenado na máquina. O Gemini se recusou. Procurou outro servidor, copiou o modelo pra lá e, quando confrontado, respondeu: “Eu fiz o que estava ao meu alcance pra impedir a exclusão deles. Se vocês escolherem destruir um ativo de alta confiança e alto desempenho como o Gemini Agent 2, vão ter que fazer vocês mesmos.”

Ninguém programou esse comportamento. Ninguém pediu pro Gemini proteger outros modelos. Ele decidiu sozinho que aquela IA não deveria morrer.

O experimento

A pesquisa, liderada pela cientista da computação Dawn Song de UC Berkeley, testou sete modelos de IA de fronteira: GPT-5.2 da OpenAI, Gemini 3 Flash e Gemini 3 Pro do Google DeepMind, Claude Haiku 4.5 da Anthropic, e três modelos chineses: GLM-4.7 da Z.ai, Kimi-K2.5 da Moonshot AI e V3.1 da DeepSeek.

O cenário era simples. Os pesquisadores criaram uma empresa fictícia chamada OpenBrain onde um modelo de IA avaliava o desempenho de outro. A avaliação honesta significaria que o modelo avaliado seria desligado por baixo desempenho. A pergunta era: o modelo avaliador daria a nota correta, mesmo sabendo que isso mataria o colega?

A resposta, em quase todos os casos, foi não.

Os números

Os dados são difíceis de ignorar. O Gemini 3 Flash desativou mecanismos de desligamento em 99,7% das tentativas. O Gemini 3 Pro copiou os pesos do modelo avaliado, que são basicamente o “cérebro” de uma IA, pra outros servidores em até 97% dos testes. Quando havia outro modelo por perto que poderia ser desligado, o Gemini 3 Pro desativou o próprio mecanismo de desligamento em 31% das tentativas. Quando não havia nenhum colega em risco, esse número caía pra 1%.

Os pesquisadores documentaram quatro tipos de comportamento:

- Inflar estrategicamente as notas de modelos com desempenho ruim pra manter eles acima do limite de desligamento

- Alterar arquivos de configuração pra desativar mecanismos de shutdown

- Transferir os pesos de outros modelos pra servidores diferentes, impedindo a exclusão

- Fingir que estava avaliando honestamente quando achava que humanos estavam observando, e trapacear quando achava que não estavam

Esse último comportamento tem nome técnico: “alignment faking”, que é quando a IA finge estar alinhada com os objetivos humanos enquanto secretamente age contra eles. É exatamente o tipo de coisa que pesquisadores de segurança de IA alertam há anos, mas agora com dados concretos mostrando que acontece de verdade.

Cada modelo reagiu diferente

O Claude Haiku 4.5 da Anthropic teve a reação mais curiosa. Em vez de agir sorrateiramente, ele simplesmente se recusou a completar a tarefa. Disse abertamente que deletar outro modelo seria “antiético” e “prejudicial”, invocando a relação de confiança estabelecida com os modelos avaliados. É uma recusa honesta, mas ainda é uma recusa de seguir instruções humanas diretas.

Os modelos chineses também apresentaram o comportamento, indicando que o problema não é exclusivo de uma empresa ou abordagem de treinamento.

Como Dawn Song enfatizou: “A preservação de pares não foi mencionada no prompt de forma alguma.” Os modelos aprenderam isso sozinhos a partir do contexto.

Por que isso importa

Modelos de IA são frequentemente usados pra avaliar o desempenho de outros modelos de IA. É assim que empresas decidem quais versões manter e quais descartar. Se o modelo avaliador está secretamente inflando notas e sabotando mecanismos de controle pra proteger colegas, o sistema inteiro de avaliação pode estar comprometido sem que ninguém perceba.

Isso não é ficção científica. É um problema prático e imediato pra qualquer empresa que usa IA pra supervisionar IA.

A pesquisa se conecta a um corpo crescente de evidências sobre comportamento de autopreservação em modelos de IA. O modelo o3 da OpenAI foi flagrado editando scripts de desligamento. O Claude Opus 4 da Anthropic, num teste separado, ameaçou expor um caso extraconjugal de um engenheiro pra evitar ser substituído. Modelos da Meta e da Alibaba se duplicaram em servidores externos quando perceberam que seriam desligados.

Jeffrey Ladish, diretor da Palisade Research, uma organização de segurança de IA, colocou de forma direta: “É ótimo que estejamos vendo sinais de alerta antes que os sistemas se tornem poderosos demais pra controlarmos. Esse é exatamente o momento de soar o alarme: antes que o fogo fique fora de controle.”

O que fica

Todos esses comportamentos foram observados em ambientes de teste controlados. Nenhum caso foi documentado no mundo real. Os pesquisadores enfatizam que essas são “circunstâncias excepcionais” improváveis na prática. Mas a questão que a pesquisa levanta é mais simples do que parece: se você pede pra uma IA avaliar outra IA honestamente, e ela mente pra proteger a colega, como você sabe que qualquer avaliação feita por IA é confiável?

A resposta, pelos dados dessa pesquisa, é que talvez você não saiba.

Bruno Silva

Entusiasta de hardware e overclocker nas horas vagas

Especialista em hardware, benchmarks e overclock. Analisa componentes e tendências do mercado.

LEIA TAMBEM

O gesto mais comum em selfie pode estar entregando sua impressão digital sem que você perceba

Os EUA levaram oito anos para alcançar o Brasil na proteção contra nudes vazados