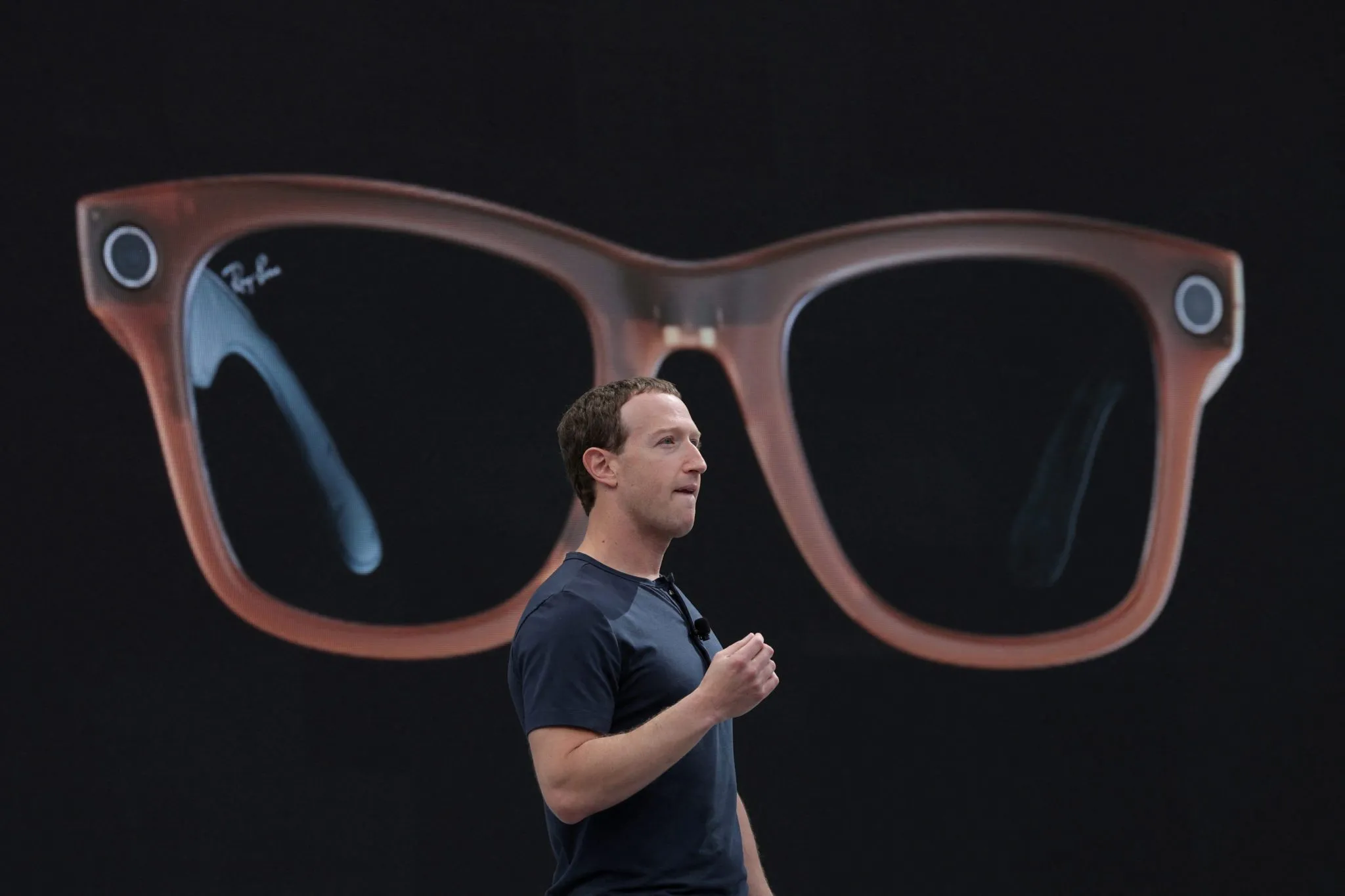

O que acontece quando você fala "Hey Meta" e um estranho no Quênia assiste

Vídeos dos óculos Ray-Ban Meta são revisados por humanos no Quênia. Incluindo os íntimos.

Eu editei um blog de NUDEZ por mais de dez anos.

Mulheres mandavam fotos porque queriam mandar, porque a exibição era parte do prazer e a decisão era inteiramente delas, e durante toda a existência daquele site - mais de uma década de corpos expostos por escolha própria - eu mantive três regras que nunca foram negociáveis: verificar a identidade de quem mandava, atender qualquer pedido de remoção na hora, e não vazar NADA. Nunca (vocês não fazem IDEIA de quantos delinquentes já me ofereceram dinheiro pelas fotos que eu tirei do ar e pela identidade de quem mandou).

Um cara anônimo na internet, sem departamento jurídico, sem compliance officer, sem termos de serviço redigidos por quarenta advogados em três fusos horários, conseguiu manter um nível de respeito pela intimidade alheia que a Meta - uma empresa que vale mais do que o PIB da maioria dos países onde opera - aparentemente considera opcional.

Digo aparentemente porque os fatos, quando a gente os organiza, têm uma eloquência própria que dispensa adjetivos.

Uma investigação dos jornais suecos Svenska Dagbladet e Göteborgs-Posten ouviu mais de 30 funcionários da Sama - empresa subcontratada pela Meta em Nairóbi - e o que descreveram não é um problema técnico. É um quadro clínico. Esses trabalhadores assistem, dia após dia, a filmagens capturadas pela câmera dos óculos Ray-Ban Meta: pessoas se despindo, usando o banheiro, FORNICANDO, exibindo sem querer números de cartão de crédito para uma lente embutida numa armação de óculos.

Um anotador contou ter visto um homem pousar os óculos na mesa de cabeceira e sair do quarto. A esposa entra. Troca de roupa. Não sabe que está sendo filmada. Não sabe que um homem em Nairóbi, sentado numa sala sem celular, vigiado por câmeras, vai assistir a isso e anotar o que vê num formulário de treinamento de inteligência artificial.

O que me interessa aqui não é a indignação - indignação é fácil, é barata, dura o tempo de um ciclo de notícias e não muda nada. O que me interessa é a ESTRUTURA. Porque existe uma arquitetura psíquica por trás de como a Meta lida com intimidade que é, se a gente olha com atenção suficiente, patológica no sentido técnico do termo.

Consentimento não é um conceito jurídico. Quer dizer, também é, mas antes de ser jurídico ele é psicológico, relacional, e diz respeito à capacidade de uma pessoa de entender o que está acontecendo com seu próprio corpo e sua própria imagem e DECIDIR sobre isso. É o que separa o exibicionismo saudável da violação. É o que separava o meu blog - onde cada mulher sabia exatamente quem ia ver, em que contexto, e podia revogar essa permissão a qualquer momento - do que a Meta faz quando enfia uma câmera numa armação de óculos e envia o que ela captura para um pipeline de anotação de dados do outro lado do planeta.

No meu blog, o consentimento era contínuo. A pessoa podia retirar a qualquer hora. Na estrutura da Meta, o consentimento é um evento único - um clique num “aceito” que ninguém lê - e depois disso o que acontece com a sua imagem, com a imagem da sua esposa, com a imagem de qualquer pessoa que esteja no campo de visão da câmera, não é mais problema seu. É problema de ninguém. Ou melhor: é problema de um trabalhador no Quênia que não pode fazer perguntas porque “se você começa a fazer perguntas, você é demitido”.

O processo é esse: o usuário diz “Hey Meta”, os óculos capturam imagem e áudio, o material vai para servidores, parte dele entra no processo de anotação de dados onde humanos identificam elementos visuais para treinar modelos de visão computacional. Os termos de serviço dizem que interações podem ser revisadas “de forma automatizada ou manual (humana)”. Manual. Humana. Palavras que a empresa usa com a mesma naturalidade com que se descreve o processo de controle de qualidade de uma fábrica de parafusos, como se o que estivesse sendo revisado não fosse a vida íntima de pessoas que não consentiram com nada.

A Meta diz que rostos são borrados automaticamente antes de chegar aos revisores. Os anotadores disseram que o sistema falha o tempo todo. Rostos continuam visíveis. A lacuna entre o que a empresa declara como salvaguarda e o que acontece na operação real é, ela mesma, um sintoma - daquele tipo de pensamento mágico corporativo onde escrever que algo funciona equivale a fazê-lo funcionar.

Existe um conceito em psicopatologia que se chama ALEXITIMIA - a incapacidade de reconhecer e nomear as próprias emoções e, por extensão, as emoções dos outros. Corporações não têm emoções, claro. Mas têm cultura, têm padrões de resposta, têm maneiras de processar informação sobre sofrimento alheio. E o padrão da Meta é textualmente alexitímico: quando confrontada com o fato de que trabalhadores no Quênia assistem a pessoas transando sem consentimento, a empresa responde que o material é processado “de acordo com os Termos de Serviço e a Política de Privacidade do Meta AI”. Não endereça. Não nomeia. Não reconhece. Aponta para um documento. É o equivalente institucional de dizer “eu não bati, e se bati não doeu, e se doeu não foi minha culpa”.

A Sama já apareceu nesse tipo de história antes. Prestou serviços de moderação de conteúdo para a Meta e para a OpenAI, saiu em 2023 depois de reportagens sobre trauma psicológico e práticas antissindicais. Trocou moderação de redes sociais por anotação de dados de IA. A distinção entre os dois, do ponto de vista do dano ocupacional, é principalmente semântica. E do ponto de vista do que a gente sabe sobre trauma vicário e exposição repetida a conteúdo perturbador, não há protocolo de “borrar rostos” que proteja uma pessoa de assistir, oito horas por dia, à intimidade não-consentida de desconhecidos.

No Brasil, a LGPD classifica imagem como dado pessoal e dado sensível quando associada a identificação biométrica. Especialistas ouvidos pelo TechTudo e pelo Estado de Minas afirmam que termos de uso genéricos podem NÃO ser suficientes para cobrir esse tipo de tratamento, especialmente quando envolve imagens de terceiros que nunca interagiram com nenhum documento da Meta. Existe um ordenamento jurídico. A ANPD tem competência para agir. Nos Estados Unidos, a Clarkson Law Firm entrou com ação judicial contra a Meta e a Luxottica. Sete milhões de pessoas compraram esses óculos em 2025. Nenhuma delas leu o que “revisão humana” significa na prática.

Eu passei mais de uma década lidando com o corpo alheio exposto por vontade própria e aprendi uma coisa que a Meta, com todos os seus recursos, parece não ter aprendido ou não querer aprender (spoiler: é a segunda opção): que a distância entre exibição e violação não é de grau. É de CONSENTIMENTO. É binário. Ou a pessoa sabe e escolhe, ou não sabe e não escolhe, e nesse segundo caso não importa quantos advogados redigiram os termos de serviço nem quantos algoritmos você diz que borram rostos - o que você está fazendo é violar a intimidade de alguém. E terceirizar essa violação para um trabalhador precarizado em Nairóbi não a torna menor. Torna mais barata.

Zuckerberg chamou os óculos de “o formato ideal para a superinteligência pessoal”.

Pessoal de quem?

Sicko

Ex editor de gente pelada. Agora lê livros.

Editor literário e resenhista. Especialista em ficção, graphic novels e cultura digital.

LEIA TAMBEM

O gesto mais comum em selfie pode estar entregando sua impressão digital sem que você perceba

Os EUA levaram oito anos para alcançar o Brasil na proteção contra nudes vazados