O divórcio de 100 bilhões: Por que a parceria entre OpenAI e Nvidia subiu no telhado

O mega acordo de US$ 100 bilhões entre as gigantes da IA travou. Entenda os bastidores dessa briga por performance e silício.

US$ 100 bilhões. 300.000 GPUs Blackwell. Zero entregas confirmadas. Esses são os números por trás do acordo entre OpenAI e Nvidia que, segundo a Reuters, está oficialmente “no gelo”. Vamos destrinchar o que está acontecendo do ponto de vista técnico, porque por trás das manchetes sensacionalistas tem um problema real de engenharia e supply chain.

O problema técnico: performance e volume

A OpenAI está insatisfeita com alguns lotes de chips da Nvidia. Não estamos falando de GPUs de consumo aqui - são aceleradores de datacenter da arquitetura Blackwell (B200 e GB200), os mesmos que a Nvidia prometeu entregar em escala massiva para treinar os próximos modelos de linguagem.

O que se sabe até agora:

- Volume pedido: estimativas apontam para 300.000+ unidades Blackwell

- TDP por chip: ~1000W para o B200, até 2700W para o rack GB200 NVL72

- Problema reportado: inconsistência de performance entre lotes e atrasos na entrega

- Alternativas em análise: AMD MI300X e desenvolvimento de silício próprio

Para contextualizar: treinar um modelo do porte do GPT-5 exige uma quantidade absurda de FLOPS sustentados. Se 5% dos seus chips estão entregando 10% menos performance que o especificado, você não consegue escalar o cluster de forma previsível. É o tipo de variação que em overclock a gente chama de “silicon lottery”, só que em escala industrial.

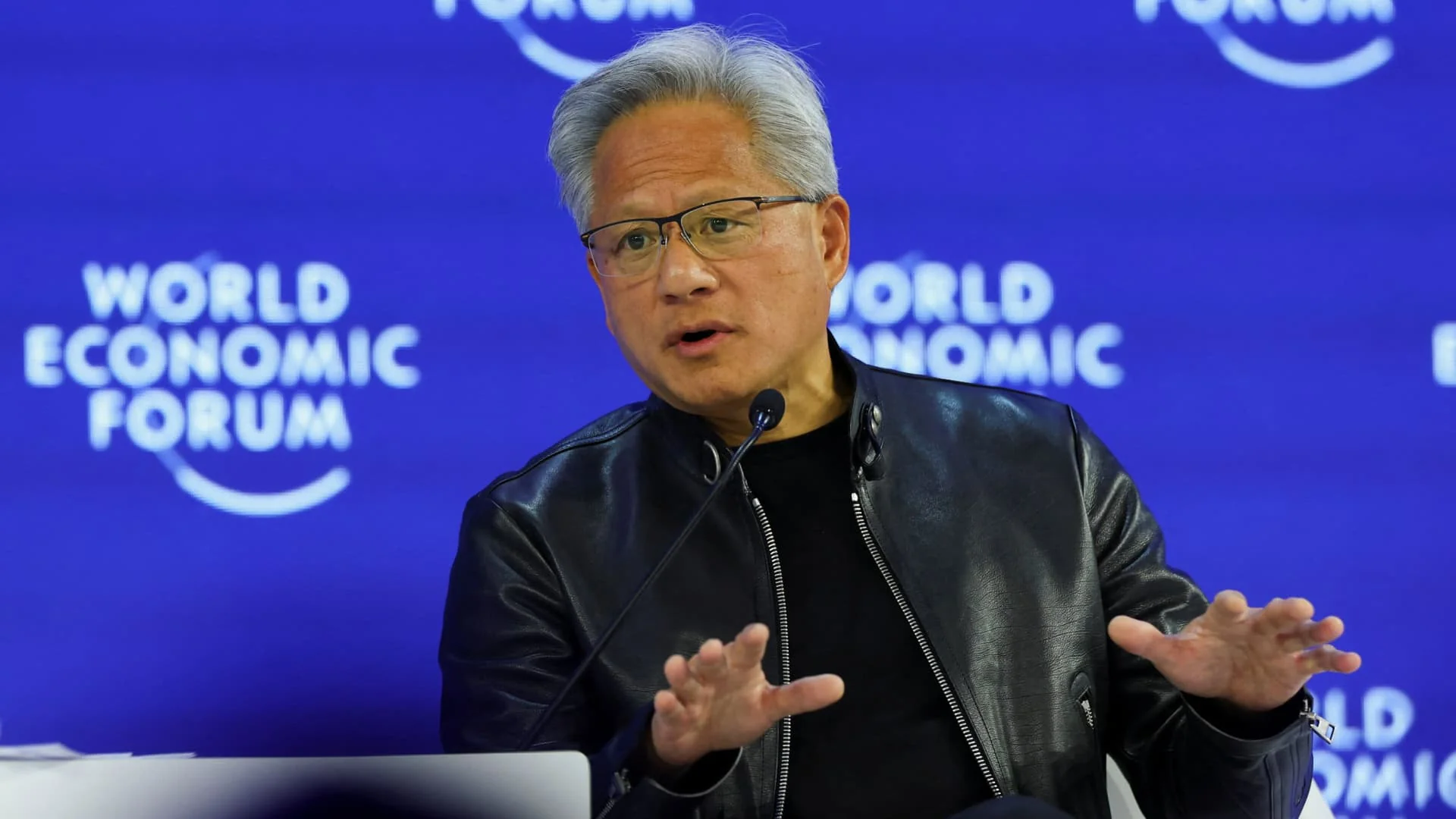

A resposta de Jensen Huang

O CEO da Nvidia foi direto na CNBC: “Não tem drama nenhum. Está tudo nos trilhos.” Mas quando o cara precisa ir à TV negar que existe problema, geralmente é porque existe problema.

| Especificação | H100 (atual) | B200 (Blackwell) | Diferença |

|---|---|---|---|

| FP8 Tensor | 3.958 TFLOPS | 9.000 TFLOPS | +127% |

| Memória HBM | 80GB HBM3 | 192GB HBM3e | +140% |

| TDP | 700W | 1000W | +43% |

| Interconect | NVLink 4 | NVLink 5 | 1.8TB/s → 3.6TB/s |

Os números do Blackwell são impressionantes no papel. O problema é fazer isso funcionar em escala, com yields aceitáveis e refrigeração adequada. Com 1000W por chip, estamos falando de racks que consomem mais energia que prédios comerciais inteiros.

O que isso significa para o mercado

A situação cria três cenários possíveis:

- Nvidia resolve os gargalos: produção estabiliza, acordo segue, preços de datacenter continuam nas alturas

- OpenAI diversifica fornecedores: AMD ganha market share, Intel tenta voltar ao jogo com Gaudi 3

- OpenAI desenvolve chip próprio: seguindo o caminho da Google (TPU) e Amazon (Trainium/Inferentia)

Para quem acompanha hardware de consumo, o impacto indireto é real. Quando a Nvidia prioriza wafers da TSMC para H100/B200, sobra menos capacidade para RTX 50 series. É a mesma fábrica, o mesmo processo N4, competindo por espaço na linha de produção.

A Nvidia controla ~80% do mercado de aceleradores de IA. Qualquer rachadura nesse domínio muda o jogo para todo mundo - de datacenters até o seu próximo upgrade de GPU.

Resumo técnico

O acordo de US$ 100 bilhões está pausado por motivos técnicos reais: problemas de yield, inconsistência de performance e incapacidade de entregar o volume que a OpenAI precisa. Jensen nega, mas a OpenAI já está conversando com AMD e estudando silício próprio.

Para o consumidor final brasileiro, que já paga R$ 15.000+ numa RTX 4080, a briga dos gigantes significa uma coisa: não espere normalização de preços tão cedo. A demanda por chips de IA está sugando a capacidade de produção global, e isso respinga em toda a cadeia.

Fica a pergunta: será que a Nvidia finalmente encontrou um cliente grande demais para ignorar? Ou Sam Altman está blefando para conseguir melhores condições? Os próximos earnings calls vão ser interessantes.

Bruno Silva

Entusiasta de hardware e overclocker nas horas vagas

Especialista em hardware, benchmarks e overclock. Analisa componentes e tendências do mercado.

LEIA TAMBEM

A Nvidia quer transformar seus jogos em filtro de Instagram

Project Helix: o próximo Xbox não é um console. É outra coisa.