Verificação de Idade por IA do Roblox Virou um Pesadelo para Jogadores

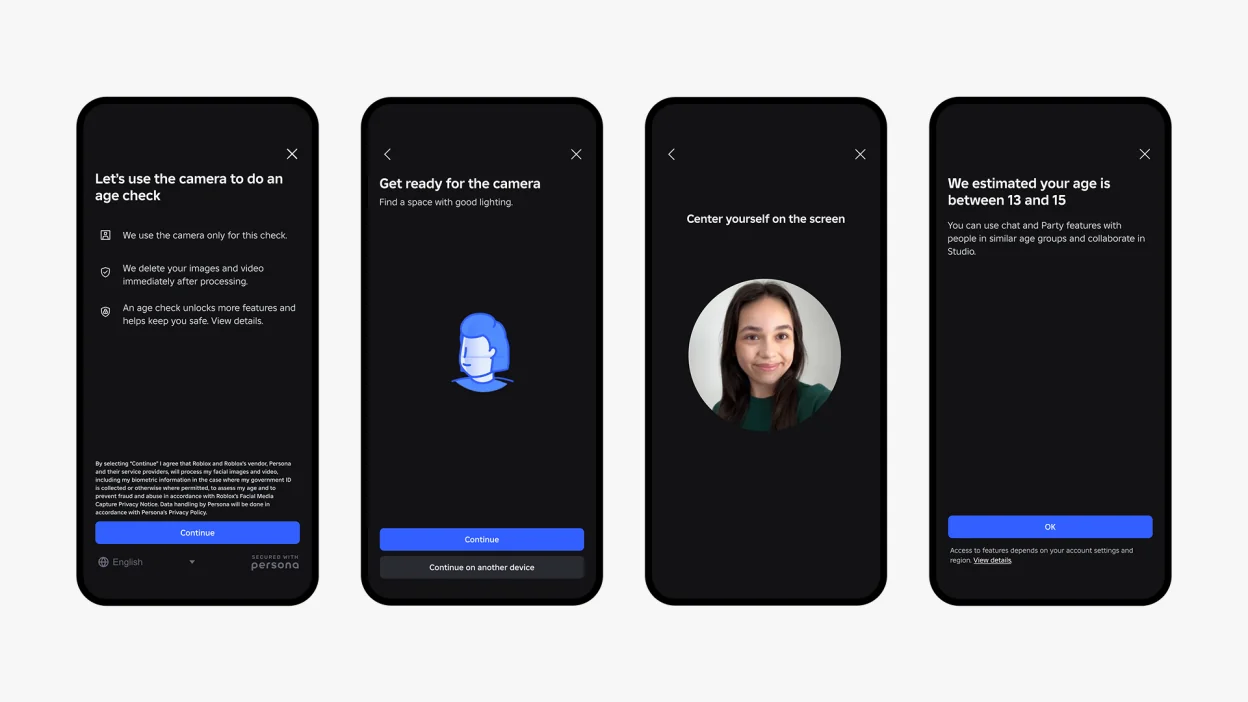

Prometida como solução definitiva, a nova verificação facial do Roblox está errando idades, bloqueando adultos e revoltando a comunidade global.

Imagina a cena: você tem 23 anos, usa a plataforma há anos para desenvolver jogos ou curtir com amigos, e de repente uma inteligência artificial decide que você é um adolescente de 16. O resultado? Você perde o acesso ao chat de voz e recursos exclusivos para adultos. Pois é, essa é a realidade caótica da nova verificação de idade do Roblox que acabou de ser lançada globalmente. O que a empresa chamou de “padrão ouro” de segurança está se transformando, na prática, em uma dor de cabeça gigante para a comunidade.

Mas, como a gente bem sabe no mundo da tecnologia, entre a promessa e a entrega existe um abismo enorme.

Uma IA que erra feio na matemática

A ideia era simples: usar IA para escanear rostos e tentar adivinhar a idade dos usuários, separando adultos de crianças. Segundo a reportagem da WIRED, a ideia é impedir que adultos interajam livremente com crianças que eles não conhecem. O que eles chamaram de ‘padrão ouro’ de segurança está virando um baita problemão para a galera, na real.

O problema é a execução. Desde que o sistema saiu da fase de testes na Austrália, Nova Zelândia e Holanda e chegou ao resto do mundo, o que a gente vê é uma enxurrada de reclamações. A IA simplesmente não consegue acertar a idade das pessoas com a precisão necessária.

”Eu não quero conversar com crianças”

Os relatos são frustrantes e, às vezes, até cômicos se não fossem trágicos. Tem usuário de 23 anos sendo identificado como alguém de 16 ou 17. Outro caso relatado na WIRED mostra um jogador de 18 anos que o sistema teimou em classificar como alguém entre 13 e 15 anos.

A reação foi imediata. Um usuário desabafou no X (antigo Twitter): “Eu não quero ficar conversando com crianças”. E ele tem razão. Se a ferramenta que deveria segregar os públicos por faixa etária falha logo na identificação, ela acaba criando o exato oposto do ambiente seguro que prometeu. Em vez de proteger, ela está misturando todo mundo de forma aleatória ou bloqueando quem não deveria ser bloqueado.

💡 Fica a dica: Se você for tentar verificar sua conta agora, esteja preparado para possíveis erros. Muita gente está preferindo esperar a poeira baixar antes de submeter o rosto ao escaneamento.

O sistema foi pensado para ser uma barreira de proteção.

Não é surpresa que a galera esteja revoltada. Fóruns de desenvolvedores, Reddit e TikTok foram inundados com protestos. A sensação geral é de que o recurso foi lançado “bugado” e empurrado goela abaixo dos usuários sem os testes necessários.

Adesão baixíssima e desconfiança

O dado mais alarmante para o Roblox, no entanto, não são as reclamações nas redes sociais, mas sim a frieza dos números. Durante os testes iniciais nos países selecionados, apenas metade dos jogadores optou por verificar a idade. Isso mesmo, 50%.

Quando metade da sua base de usuários ativos ignora uma funcionalidade que a empresa considera crucial, tem algo muito errado acontecendo. E o motivo é óbvio: privacidade. Entregar seus dados biométricos faciais para uma plataforma de jogos já é algo que deixa muita gente com o pé atrás. Quando essa ferramenta funciona mal, a confiança despenca. E para uma plataforma social, ficar sem chat é basicamente ficar isolado.

Por que agora? A pressão dos tribunais

Se o sistema está tão quebrado, por que o Roblox lançou isso globalmente com tanta pressa? A resposta, como quase sempre nesses casos, envolve advogados e processos judiciais.

O Roblox está na mira de procuradores-gerais em estados como Louisiana, Texas e Kentucky. As acusações são pesadas: os processos alegam que a plataforma facilita o acesso de predadores a crianças e não faz o suficiente para proteger os menores de exploração. Até intimações criminais foram emitidas na Flórida para investigar essas falhas de segurança.

Tentando apagar o incêndio

Nesse contexto, a implementação da IA parece uma resposta desesperada para mostrar serviço. O CEO do Roblox anunciou essas novas regras logo após essa onda de processos, tentando provar que a empresa está agindo.

Segundo o comunicado oficial sobre segurança, a intenção é criar um ambiente onde as interações sejam apropriadas para cada faixa etária. Eles até planejam expandir essas verificações para ferramentas de criação em 2026. Mas, sinceramente? Lançar uma ferramenta que funciona mal apenas para acalmar reguladores é um tiro no pé com a comunidade.

O futuro da segurança ou só mais um flop?

A galera não aguentou a mudança. É necessário e urgente. E essa tal obrigatoriedade disfarçada só complica. O Roblox diz que é opcional, mas se você não fizer, perde o chat.

O Roblox promete que esse é o “padrão ouro”. Por enquanto, parece mais latão enferrujado. A empresa vai ter que correr muito atrás para calibrar essa IA, ou vai acabar alienando os jogadores adultos que sustentam a economia da plataforma.

E você, vai arriscar escanear o rosto ou prefere ficar sem o chat por enquanto? Conta aí nos comentários se você teve coragem de testar.

Marina Costa

Entusiasta de tech e indie games

Especialista em games indie e multiplayer. Jogadora e analista de mecânicas de jogo.

LEIA TAMBEM

A Flórida virou o primeiro estado a processar a OpenAI - e quer Sam Altman pagando do próprio bolso

A IA vai fazer 80% das suas tarefas. Os 20% que sobram decidem seu emprego